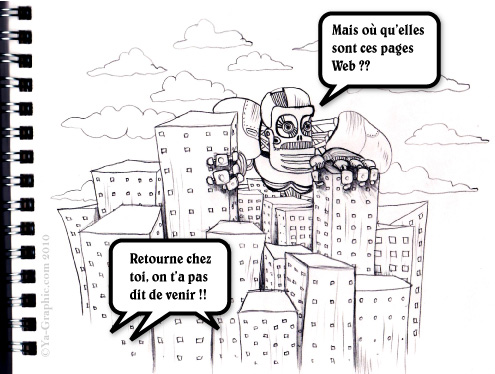

L’utilité du fichier robots.txt

Les robots de moteurs de recherche (appelés aussi spiders ou crawlers) sont des programmes qui explorent en permanence les pages Web du monde. Les moteurs de recherche (Google, Bing et Yahoo!) les exploitent pour indexer de nouvelles pages Web. Bloquer ou supprimer des pages à l'aide...